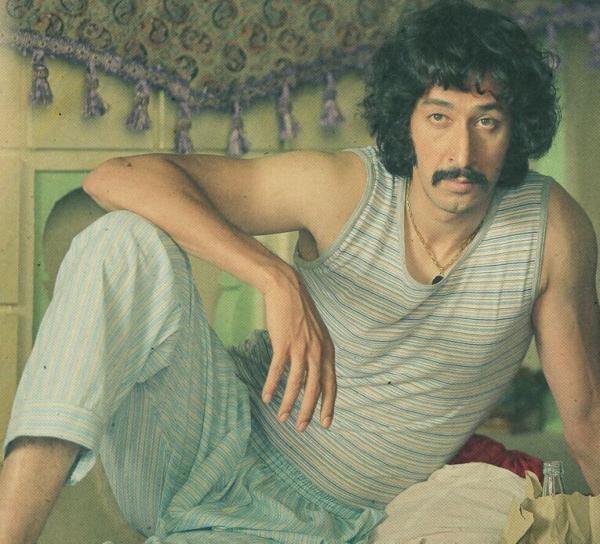

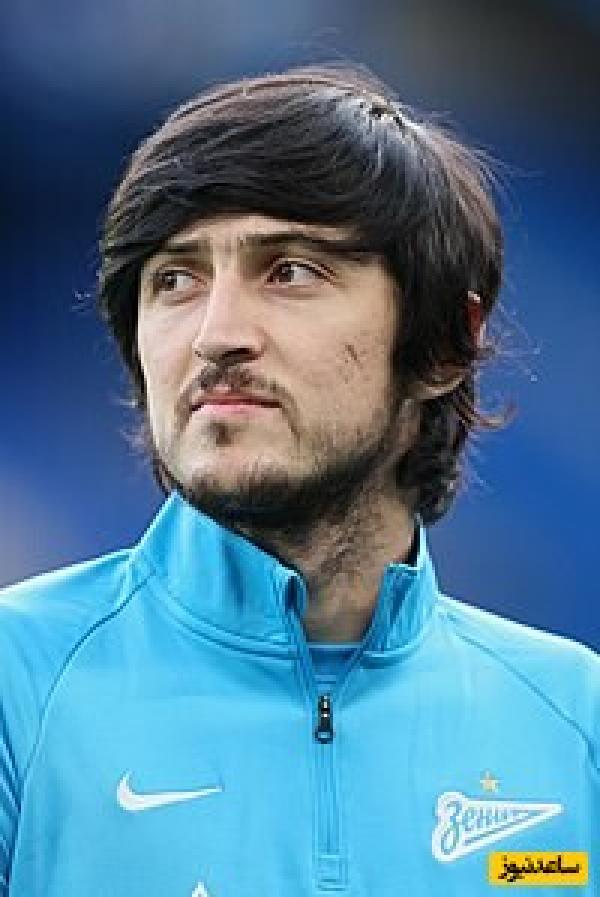

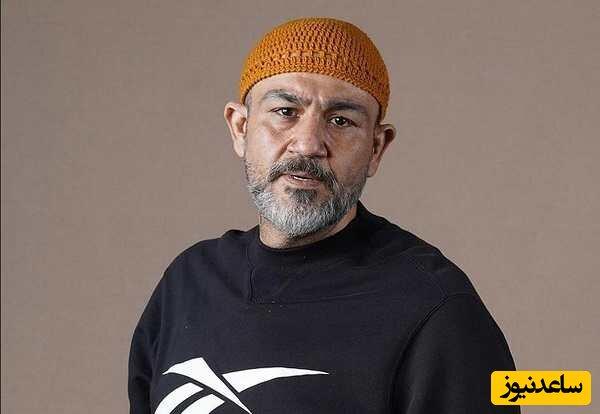

به گزارش همشهری آنلاین، در این برنامه میزبان «محمد برادران»، پژوهشگر حوزه AI و عضو هیات علمی دانشگاه آزاد تهران شمال بودیم و در خصوص چتباتها گفتوگو کردیم که بخشی از آن را ملاحظه میکنید.

دستیار هوشمند یا جایگزین خطرناک؟

با گسترش چشمگیر هوش مصنوعی در سالهای اخیر، پرسشهای اساسی درباره کارکرد، کاربرد، فرصتها و تهدیدات این فناوری نوین در حوزههای گوناگون، بهویژه آموزش و پژوهش، مطرح شده است. چتباتهایی مانند ChatGPT، جمینای گوگل و دیپسیک چینی، در ظاهر بهعنوان ابزارهای کمککننده به انسان معرفی میشوند، اما استفاده نادرست از آنها میتواند به آسیبهای جدی علمی، اخلاقی و شغلی منجر شود.

وقتی چتبات جای خلاقیت را میگیرد

چالش اصلی، جایی آغاز شد که کاربران —بهویژه دانشجویان— بهجای بهرهگیری از این ابزار بهعنوان مکمل، از آن بهعنوان جایگزین استفاده کردند. بسیاری از دانشجویان، پایاننامه یا مقاله خود را صرفا از طریق خروجی چتبات تهیه میکنند؛ بدون آنکه شناختی از صحت منابع یا تحلیل علمی داشته باشند. حتی برخی، برای فریب استادان، بهطور عمدی اشتباهاتی را به متن اضافه میکنند تا طبیعیتر جلوه کند.

ناآگاهی، ریشه اصلی سوءاستفادهها

بسیاری از سوءاستفادهها از هوش مصنوعی ناشی از ناآگاهی است. نبود دورههای آموزشی تخصصی در دانشگاهها، حتی برای اساتید، موجب شده استفاده از ابزارهایی مانند ChatGPT بدون راهنمایی و نظارت انجام شود. نتیجه، تولید انبوه متونی است که نه فقط فاقد اعتبار علمی هستند، بلکه هویت علمی و تحقیقی دانشجویان را نیز زیر سوال میبرند.

حلقه مفقوده حکمرانی فناوری

در بسیاری از کشورها، هنوز قوانین مشخص و سختگیرانهای برای استفاده از هوش مصنوعی در آموزش، نشر و مالکیت فکری وضع نشده است. این خلأ قانونی، بستر سوءاستفاده گستردهای را فراهم کرده است؛ تا جایی که حتی مراکزی تبلیغ میکنند که میتوانند پایاننامه دکترا را با کمک چتباتها در یک ماه تحویل دهند.

منابع جعلی و سوءگیری الگوریتمی

یکی از معضلات هوش مصنوعی، ارائه منابع غیرواقعی و اطلاعات سوءگیرانه است. الگوریتمهای یادگیری ماشینی، با تکرار و تایید کاربران، ممکن است اطلاعات نادرست را بهعنوان حقیقت علمی تلقی کرده و منتشر کنند. این امر بهویژه در حوزههای علمی و دانشگاهی، تهدیدی جدی برای اعتبار پژوهشهاست.

اخلاق فردی و مسئولیت پژوهشگر

هر پژوهشگر باید بداند که استفاده از هوش مصنوعی، همچون استفاده از هر منبع خارجی، نیازمند رعایت اصول اخلاقی و علمی است. ذکر منابع، درک محدودیتهای الگوریتمی و استفادهی هدفمند از ابزار، پایههای یک رفتار حرفهای و مسئولانه است.

چگونه از آسیبها جلوگیری کنیم؟

۳گام اساسی برای استفاده سالم از هوش مصنوعی عبارتاند از:

- آموزش عمومی و تخصصی در مدارس، دانشگاهها و فضای عمومی.

- وضع قوانین شفاف، قابل اجرا و بینالمللی برای صیانت از حقوق مولفان و حفظ کیفیت پژوهش.

- نهادینهسازی اخلاق حرفهای در کاربران، بهویژه در جوامع علمی و فرهنگی.

تهدید یا فرصت؟

هوش مصنوعی، در ذات خود تهدید نیست؛ بلکه فرصتی بینظیر برای ارتقای کیفیت زندگی، علم، و بهرهوری است؛ بهشرطی که با نگاه مسئولانه، قانونمند و خلاق با آن برخورد شود. همانطور که قلم، چاپ و رسانه تهدید نبودند، هوش مصنوعی هم ابزاری در دستان انسان است؛ انتخاب با ماست که از آن چگونه استفاده کنیم.