بازی کثیف الگوریتمها/ وقتی عدالت دیجیتال قربانی سودآوری میشود

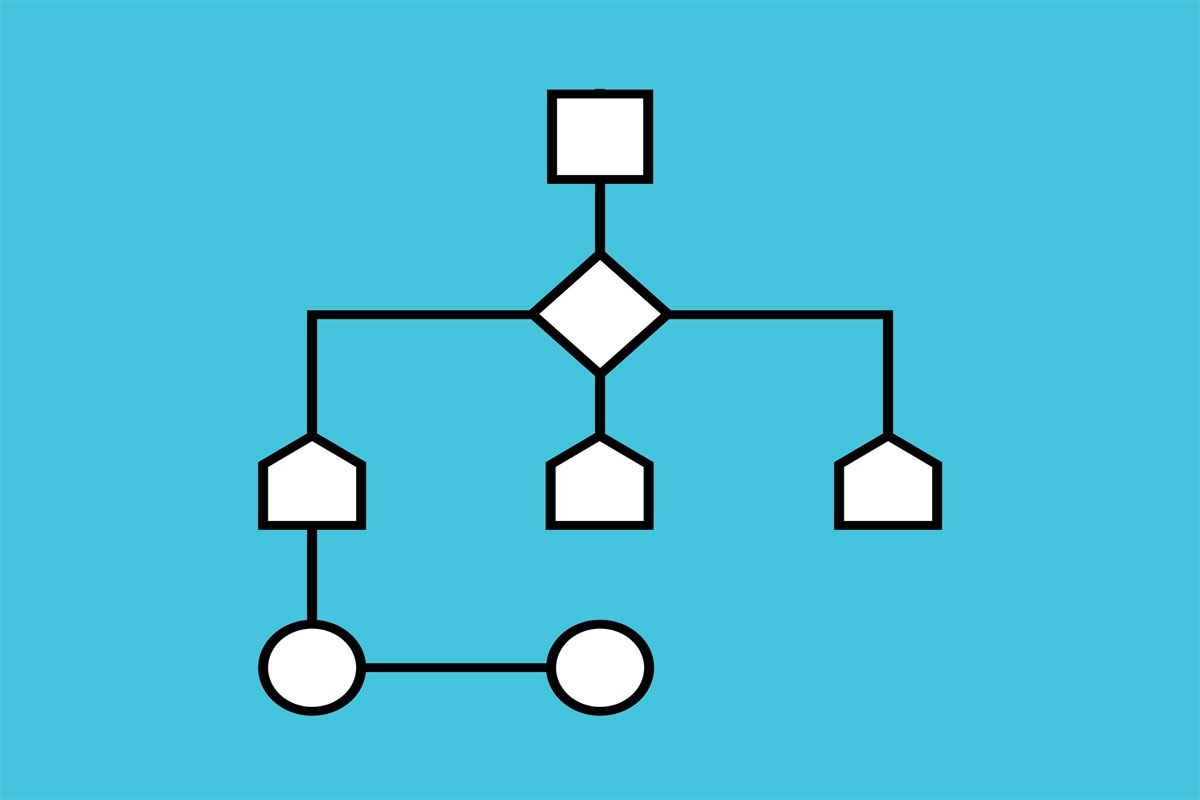

پشت پرده پلتفرمهای دیجیتال چه میگذرد؟ چرا برخی برندها همیشه در صدرند و بعضی دیگر هرگز دیده نمیشوند؟ آیا الگوریتمها بیطرفاند یا به نفع گروهی خاص طراحی شدهاند؟

اقتصادآنلاین، مهرین نظری: وقتی همهچیز با داده کنترل میشود، دیگر «بیعدالتی» فقط معنای سیاسی یا اقتصادی ندارد. تبعیض در دنیای دیجیتال نه با زور اسلحه، بلکه با قدرت الگوریتم رخ میدهد. نرم، بیصدا و اغلب بدون اینکه کسی متوجه شود. پلتفرمهای دیجیتال، با الگوریتمهایی که جعبه سیاه باقی ماندهاند، عملاً تصمیم میگیرند که چه کسی دیده شود، چه کسی فراموش شود، و چه کسی شایسته رشد است. این تصمیمگیریها (اگرچه به ظاهر فنی و خودکارند) اما واقعیت پیچیدهتری دارند که به ساختاری عمیق از تبعیض منتهی میشود.

اولویت با کیست؟ وقتی عدالت در سرچ دفن میشود

پلتفرمهای دیجیتال مدعیاند که الگوریتمهایشان خنثیاند. اما تجربه کاربران و کسبوکارهای کوچک خلاف این را نشان میدهد. جستوجوی یک کالا، سرویس یا خدمت خاص در این پلتفرمها، اغلب نتایجی را نمایش میدهد که یا به شرکای تجاری نزدیکاند یا به کسبوکارهایی که بیشترین درآمد را برای پلتفرم تولید میکنند. این یعنی عدالت در توزیع نمایش، عملاً یک افسانه است.

تحقیقات بینالمللی از جمله مطالعه سال ۲۰۲۳ دانشگاه MIT نشان دادهاند که الگوریتمهای جستوجو و پیشنهاددهی بسیاری از پلتفرمهای بزرگ، به شکلی سیستماتیک کسبوکارهای کوچکتر یا تازهوارد را به حاشیه میرانند. در این مدل، آنچه دیده میشود نه بر اساس کیفیت واقعی یا ترجیح کاربران، بلکه براساس سودآوری برای خود پلتفرم انتخاب میشود.

در این میان، گاه الگوریتمها بدون اطلاع قبلی تغییر میکنند و حتی رتبهبندی صفحات، نتایج جستوجو یا نرخ تبدیل کاربران تحت تأثیر قرار میگیرد. کسبوکارهای مستقل، ناگهان با افت بازدید و کاهش فروش مواجه میشوند، بدون اینکه بدانند چه چیزی تغییر کرده یا چگونه میتوانند به وضعیت قبل بازگردند. این سطح از ابهام، شکاف قدرت شدیدی میان پلتفرم و کاربرانش ایجاد کرده است.

الگوریتمهای سکوت، وقتی انتقاد سانسور میشود

یکی از ابعاد خطرناک الگوریتمهای تبعیضآمیز، استفاده از آنها برای کنترل یا حذف صداهای منتقد است. در پلتفرمهایی که تعامل و نظرات کاربران نقش مهمی در دیدهشدن دارد، گزارشهایی وجود دارد که نشان میدهد انتقاد از خود پلتفرم یا از برندهای همپیمان، با کاهش دسترسی، دیپرایوریتی شدن محتوا یا حتی مسدودسازی تدریجی حسابها مواجه شده است.این حذف تدریجی (که به آن «shadow banning» گفته میشود) بهگونهای عمل میکند که کاربر یا کسبوکار متوجه محدود شدن خود نمیشود، اما در عمل از چرخه رقابت حذف میشود. چنین سیاستهایی، فضای رقابت سالم را تهدید میکند و مسیر را برای سانسور خودکار، بدون دخالت انسان و بدون نظارت بیرونی، باز میگذارد.

در سالهای اخیر چندین پلتفرم بینالمللی بهدلیل چنین عملکردهایی زیر ذرهبین نهادهای نظارتی قرار گرفتهاند. اما در بسیاری از کشورها (بهویژه در بازارهای بستهتر یا تحت سلطه پلتفرمهای داخلی) چنین نظارتی اصلاً وجود ندارد یا بسیار ضعیف است. همین فقدان نظارت، الگوریتم را از یک ابزار فنی به سلاحی خاموش برای حذف تدریجی رقبای نامطلوب تبدیل کرده است.

چرا شفافیت الگوریتمی لازم است، اما هیچکس مسئول نیست؟

پلتفرمها معمولاً الگوریتمهای خود را «دارایی تجاری محرمانه» معرفی میکنند و از انتشار جزئیات آن خودداری میکنند. در ظاهر منطقی است، هر کسبوکار حق دارد فرمول موفقیت خود را مخفی نگه دارد. اما وقتی همین الگوریتمها به زیرساخت حیاتی بازار، ارتباطات، خرید و فروش، تبلیغات و حتی استخدام بدل شدهاند، دیگر نمیتوان آنها را فقط "دارایی خصوصی" دانست.

در بسیاری از کشورها، قوانین ضدانحصار بهروز نشدهاند تا الگوریتم را بهعنوان ابزار قدرت بررسی کنند. حتی در اروپا که قوانین سختگیرانهتری مانند DMA (Digital Markets Act) اعمال شده، اثبات تبعیض الگوریتمی هنوز چالشبرانگیز است. در بازارهایی مانند ایران، که بخش بزرگی از بازار دیجیتال در انحصار چند پلتفرم خاص است، نبود شفافیت الگوریتمی نهتنها رقابت را مختل کرده بلکه اکوسیستم نوآوری را از درون تهی کرده است.

پیشنهادهایی مانند «ممیزی الگوریتم» یا تشکیل نهادهای مستقل برای بررسی تبعیض در تصمیمات الگوریتمی، هنوز در مراحل اولیهاند. اما اگر این روند ادامه یابد، بهزودی باید با واقعیتی مواجه شویم که در آن نه دولتها، نه نهادهای نظارتی، بلکه چند پلتفرم بزرگ تعیین میکنند چه چیزی حقیقت است، چه کسی حق دیدهشدن دارد و چه کسی از حافظه جمعی حذف خواهد شد.

الگوریتمها بیگناه نیستند، قدرت نرم، آسیب سخت

شاید زمانی میشد گفت الگوریتم فقط یک کد بیطرف است، اما امروز دیگر چنین دیدگاهی سادهلوحانه است. الگوریتمها نهتنها توسط انسانها طراحی میشوند بلکه بازتابدهندهی اولویتها، منافع و سوگیریهای آنها نیز هستند. وقتی یک پلتفرم تصمیم میگیرد کدام کالا در صدر باشد، کدام محتوا حذف شود، یا کدام کاربر بیشتر دیده شود، عملاً در حال مهندسی واقعیت است.

در این بازی پیچیده، کسبوکارهای کوچک، تولیدکنندگان مستقل محتوا، و حتی کاربران عادی، تنها بازندگان میدان هستند. در حالی که پلتفرمها با شعار «هوش مصنوعی برای بهبود تجربه کاربری» از خود رفع مسئولیت میکنند، در عمل کنترل کامل بازار، داده و رفتار کاربران را در اختیار دارند آن هم بدون شفافیت، بدون پاسخگویی، و بدون رقابت واقعی.

برای جلوگیری از این تبعیض پنهان، لازم است نهادهای نظارتی به ابزارهای تحلیل الگوریتمی مجهز شوند. قوانین شفافیت در تصمیمگیری الگوریتمی بهروز شوند. کاربران حق داشته باشند تصمیمات پلتفرم را به چالش بکشند. و در نهایت، الگوریتمها نیز مانند دیگر ابزارهای قدرت، تحت نظارت عمومی قرار گیرند.

تا آن روز، قدرت واقعی نه در دست قانونگذاران، بلکه در کدهایی خواهد بود که تعیین میکنند چه کسی موفق میشود و چه کسی ناپدید.